Développement d’une aile volante intelligente pour le recensement de la mégafaune marine

Laboratoire d’accueil : I3S (Laboratory of Computer Science, Signals and Systems of Sophia Antipolis)

Lieu : Euclide B, 2000 Rte des Lucioles, 06900 Sophia Antipolis

Durée du contrat : 12 à 18 mois Date de prise de poste souhaitée : 3 mars 2025

Quotité : temps complet

Salaire mensuel : 2204 à 2325 euros brut (selon expérience)

Profil recherché :

Titulaire d’un master 2 / diplôme d’ingénieur en robotique / électronique

Expérience dans le développement dans les systèmes embarqué de drones aériens

Connaissance des logiciels d’autopilote open source (Ardupilot, PX4, BetaFlight …)

Expérience de développement en C++

Télépilote de drone professionnel

Expérience en aéromodélisme considérée comme un plus

Capacité à travailler dans une équipe pluri-disciplinaire

Renseignements et candidatures : Laura Mannocci (laura.mannocci@ird.fr) : https://www.researchgate.net/profile/Laura-Mannocci

Pour candidater, merci d’envoyer avant le 15 novembre 2024 :

-votre CV

-votre lettre de motivation

-le nom et contact email de 3 personnes référentes

à laura.mannocci@ird.fr en précisant ‘candidature SMART-WING’ dans l’objet de votre email.

Attention : seules les candidatures conformes au profil recherché (cf. ci-dessus) seront évaluées.

----------------------------------------------------------------------------------------------------------

Description du projet ANR SMART-WING

La mégafaune marine comprend les mammifères marins, les tortues marines, les requins et les raies qui comptent parmi les espèces les plus menacées. De plus ces espèces sont particulièrement mobiles et présentes en faibles densités sur de vastes zones. Pour identifier et protéger leurs habitats critiques, il est donc nécessaire de développer une méthode de suivi efficace à grande échelle. Les drones représentent des technologies émergentes à faible coût et à faible émission carbone pour suivre la mégafaune depuis les airs. Cependant, les relevés par drone ne parviennent pas à fournir à la fois une large couverture spatiale et une haute résolution d’image. Plus l’altitude du drone est élevée, plus la couverture spatiale est large, mais au détriment de la résolution d’image. Pourtant, les images à haute résolution acquises à basse altitude sont essentielles pour identifier et mesurer précisément les espèces. Pour rompre ce compromis entre couverture spatiale et résolution d'image, le projet SMART-

WING ambitionne de concevoir une méthodologie de suivi adaptative de la mégafaune marine basée sur une aile intelligente capable de basculer entre les modes haute et basse altitude.

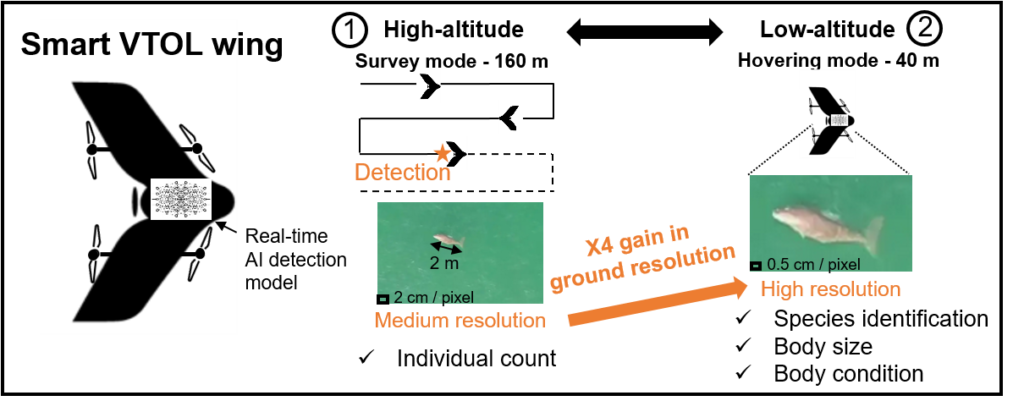

Nous intégrerons un modèle d’intelligence artificielle (IA) dans une aile à décollage et atterrissage vertical. L'aile sera d’abord programmée en mode haute altitude (160 m, résolution au sol de ~2 cm/pixel) pour une large couverture spatiale (Figure 1). En cas de détection d’espèce, elle descendra en altitude (40 m) et suivra dynamiquement l'animal afin d’acquérir des images haute résolution (~0,5 cm/pixel), multipliant ainsi par 4 la résolution au sol. Nous faisons l'hypothèse que cette méthode fournira une résolution d'image accrue sans compromettre la couverture spatiale.

Figure 1: Proposition d’aile volante intelligente pour le suivi adaptatif de la mégafaune marine

Nous implémenterons le projet SMART-WING dans le vaste lagon de Mayotte abritant des populations exceptionnelles mais mal connues de mammifères, tortues, requins et raies. SMART-WING fournira de nouvelles informations écologiques sur les populations de mégafaune à faible coûts financier et carbone en vue de l'identification de zones clés pour leur protection. Le projet a 3 objectifs:

1) Développer un prototype d'aile intelligente. Nous développerons une aile abordable, endurante, éco-responsable et facile d’utilisation, capable de voler horizontalement et verticalement. Elle sera équipée d’un mini-ordinateur embarquant un modèle léger d’IA pour détecter la mégafaune en temps réel. Nous programmerons un algorithme de re-routage sur le pilote automatique afin d’adapter la trajectoire de l’aile aux détections en temps réel. Le prototype sera testé en Méditerranée puis à Mayotte pour améliorer progressivement sa performance.

2) Suivre les abondances et les caractéristiques corporelles de la mégafaune. Nous déploierons l’aile pour suivre la mégafaune sur des milliers d’hectares dans les habitats côtiers de Mayotte pendant 2 saisons et 2 années successives. Nous analyserons les images collectées avec un modèle d'IA, quantifiant le gain de performance lors du passage du mode haute à basse altitude. Nous appliquerons ensuite ce modèle aux images haute résolution pour estimer les abondances des espèces et les tailles et conditions corporelles des individus.

3) Simuler des scénarios d'aires marines protégées (AMPs). Nous construirons des modèles statistiques pour relier les abondances des espèces à des prédicteurs environnementaux afin de fournir des prédictions d'abondance dans les zones non surveillées de Mayotte. Nous utiliserons ensuite des algorithmes de planification systématique de la conservation pour dériver des scénarios d’AMPs strictes afin de sauvegarder la mégafaune tout en prenant en compte la perte des captures de pêche.

Le projet SMART-WING catalysera le développement d'une nouvelle génération de drones capables d'ajuster dynamiquement leur trajectoire pour un suivi optimisé des espèces rares et vulnérables. Il favorisera les interactions transversales entre les scientifiques en robotique (I3S, ISEN), en intelligence artificielle (LIRMM), en écologie marine (CUFR, MARBEC) et en gestion de l'environnement (OFB-PMM).

-----------------------------------------------------------------------------------------------------------

CDD Ingénieur en robotique

Le CDD qui s’inscrit dans l’objectif 1 du projet SMART-WING vise à développer un prototype d’aile volante intelligente pour le recensement de la mégafaune marine. L’aile sera composée :

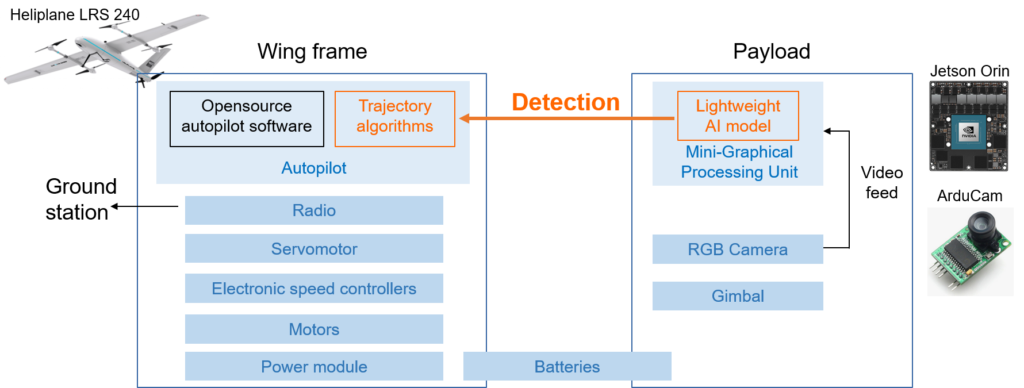

(1) d’un châssis pré-existant démontable (ex. Heliplane LRS 2401) connecté à un logiciel d’autopilote (Ardupilot2 ou Pixhawk3) sur lequel seront déployés des algorithmes de trajectoires développés à l’ISEN (Verdu et al. 2021). Le chassis comprendra également une station radio, des moteurs, des servo-moteurs, etc (Figure 2 – partie gauche).

(2) d’une charge utile incluant un mini GPU (graphical processing unit) de type NVIDIA Jetson Orin4 sur lequel sera déployé un module de détection automatisé d’espèce (intelligence artificielle telle que Mannocci et al. 2021 développée entre MARBEC et le LIRMM). Le mini GPU sera directement connecté à une caméra haute résolution de type ArduCam5 montée sur un cardan (Figure 2 – partie droite).

Le tout sera alimenté par des batteries lithium polymère.

Figure 2 : Présentation de l’aile intelligente composée d’un châssis (partie gauche) et d’une charge utile (partie droite) alimentés par des batteries. Un module de détection automatique d’espèces sera embarqué sur un mini-GPU (ex. Jetson Orin) directement connecté à une caméra RGB (ex. ArduCam). La détection d'espèce engendrera le déclenchement d’algorithmes de modification de trajectoire programmés dans l’autopilote.

1 https://www.dronevolt.com/en/expert-solutions/heliplane/#features

2 https://ardupilot.org/

3 https://pixhawk.org/

4 https://www.nvidia.com/en-us/autonomous-machines/embedded-systems/jetson-orin/

5 https://www.arducam.com/product/b0242-arducam-imx477-hq-camera/

Figure 2 : Présentation de l’aile intelligente composée d’un châssis (partie gauche) et d’une charge utile (partie droite) alimentés par des batteries. Un module de détection automatique d’espèces sera embarqué sur un mini-GPU (ex. Jetson Orin) directement connecté à une caméra RGB (ex. ArduCam). La détection d'espèce engendrera le déclenchement d’algorithmes de modification de trajectoire programmés dans l’autopilote.

Missions

L’ingénieur(e) sera responsable :

(1) Du développement de l’aile volante

-Définition du besoin, choix et dimensionnement de la plateforme

-Assemblage et tests de la plateforme

-Essais en vol pour valider la mise en oeuvre et les performances

-Intégration d’un algorithme de génération de trajectoire dynamique dans l’autopilote en lien étroit avec l’ISEN (responsable du développement de l’algorithme).

(2) De la mise au point de la charge utile

-Intégration du logiciel de détection de la mégafaune dans le mini-GPU en lien étroit avec le LIRMM (responsable du développement du logiciel)

-Interfaçage entre la caméra, le mini-GPU et l’autopilote

(3) D’une analyse de cycle de vie afin d’évaluer l’empreinte environnementale globale

L’analyse de cycle de vie intégrera toutes les étapes, incluant la manufacture et la distribution des matériaux composant l’aile, son utilisation (consommation énergétique) et sa destruction ou le recyclage de ses composants (Brusseau 2019). La consommation énergétique de l’aile sera comparée avec celle d’un avion de type cessna 180 traditionnellement utilisé pour le recensement de la mégafaune marine.

Contexte de travail

L’ingénieur(e) sera basé(e) au laboratoire I3S de Sophia Antipolis sous la supervision d’André Anglade (ingénieur de recherche en développement d’instruments scientifiques, spécialiste des drones) en lien étroit avec Laura Mannocci (chercheuse en écologie marine à MARBEC et porteuse du projet). L’ingénieur(e) travaillera également en collaboration étroite avec Titouan Verdu (chercheur en robotique et drone à l’ISEN), Régis Hocdé (ingénieur en systèmes d’observations pour le milieu marin à MARBEC) et Marc Chaumont et Gérard Subsol (chercheurs en deep learning au LIRMM). Des missions sont prévues pour des réunions de projet à Montpellier. L’ingénieur(e) participera également à des missions de terrains dédiées au déploiement et à la mise en oeuvre de l’aile volante en conditions réelles en Camargue et à Mayotte.

Bibliographie

Brusseau, M.L. (2019). Chapter 32 - Sustainable Development and Other Solutions to Pollution and Global Change. In: Environmental and Pollution Science (Third Edition) (eds. Brusseau, M.L., Pepper, I.L. & Gerba, C.P.). Academic Press, pp. 585–603.

Mannocci, L., Villon, S., Chaumont, M., Guellati, N., Mouquet, N., Iovan, C., et al. (2021). Leveraging social media and deep learning to detect rare megafauna in video surveys. Conservation Biology, 1.

Verdu, T., Maury, N., Narvor, P., Seguin, F., Roberts, G., Couvreux, F., et al. (2021). Experimental Flights of Adaptive Patterns for Clouds Exploration with UAVs. In: Experimental Robotics, Springer Proceedings in Advanced Robotics (eds. Siciliano, B., Laschi, C. & Khatib, O.). Springer International Publishing, Cham, pp. 17–27.